Internacional

Errores en Modelos de IA Generan Preocupación

Un reciente estudio publicado en la revista Nature ha encendido las alarmas sobre la precisión y confiabilidad de los modelos avanzados de inteligencia artificial, como ChatGPT. Aunque estas herramientas se utilizan cada vez más en sectores como la salud y las finanzas, los investigadores han detectado que aún presentan errores en tareas aparentemente simples, lo que podría tener graves consecuencias en su aplicación en entornos críticos.

El informe detalla cómo algunos de estos modelos han demostrado dificultades para resolver problemas matemáticos básicos o generar respuestas coherentes en situaciones complejas. Los autores del estudio advierten que, aunque los avances en IA son impresionantes, todavía es necesario mejorar su fiabilidad antes de permitir su uso en sectores sensibles donde un error podría costar vidas o causar daños financieros significativos.

A pesar de las críticas, muchas empresas continúan invirtiendo en la mejora de estos sistemas, esperando que la inteligencia artificial logre alcanzar un nivel de precisión y autonomía que pueda reemplazar o complementar a los seres humanos en una amplia gama de tareas.

Sin embargo, los expertos subrayan que el desarrollo de IA debe ir acompañado de una regulación más estricta para evitar riesgos

-

Estado23 horas ago

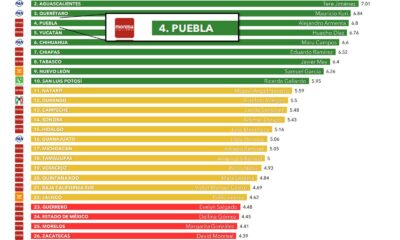

Estado23 horas agoAlejandro Armenta en el top ten en seguridad, cercanía y desempeño

-

Estado1 día ago

Estado1 día agoDécadas de olvido de alcaldes irresponsables; la Diagonal Defensores de la Repúbica es rehabilitada por el gobierno de Armenta

-

Congreso1 día ago

Congreso1 día agoPromueve diputado iniciativa para exentar del pago de grúas y corralones a víctimas de robo de vehículo

-

Portada2 días ago

Portada2 días agoLa Corte Federal aprueba bloqueo de cuentas de la UIF para combatir lavado de dinero

-

Congreso2 días ago

Congreso2 días agoCongreso del Estado presentó el libro “Feminicidio: 30 segundos de furia x 30 años de prisión”

-

Estado23 horas ago

Estado23 horas agoLa obra comunitaria en Puebla una realidad; 410 proyectos realizados en 110 municipios

-

¡Hot!23 horas ago

¡Hot!23 horas agoEn cateo la Fiscalía asegura inmueble, vehículos y droga, en Cholula

-

Sn Andrés Cholula2 días ago

Sn Andrés Cholula2 días agoCuidar a San Andrés Cholula exige responsabilidad compartida: Lupita Cuautle